Le projet

Apprentissage automatique fédéré et sécurisé

En santé, le développement de méthodes innovantes et performantes d’intelligence artificielle fondées sur l’apprentissage automatique passe par l’accès à de très larges jeux de données sensibles. Ceux-ci sont par ailleurs largement distribués sur différents sites (hôpitaux, entrepôts de données de santé …) et les centraliser à l’échelle d’une population en une seule place n’est pas envisageable. Et quand cela est possible, de nombreuses questions se posent en matière de respect du droit à la vie privée sachant que certaines données sont par nature identifiantes (e.g. données génétiques).

Dans de tels environnements, les algorithmes d’apprentissage soumis à différentes menaces cyber qui tirent avantage des vulnérabilités de leurs phases d’apprentissage et de déploiement. Par exemple, des attaques peuvent polluer des données d’apprentissage de telle sorte qu’un algorithme se trompe ou chercher à retrouver les données qui ont servi lors de l’apprentissage (e.g. identification de patients). D’autres ciblent la phase d’inférence. Il a été montré qu’il était possible qu’un système d’IA catégorise une lésion normalement identifiée comme bénigne en lésion maligne (avec 100% de confiance) par l’addition d’un bruit malveillant sur les données. Ces enjeux de robustesse et de sécurité, particulièrement d’actualité dans le contexte d’études médicales multicentriques, doivent être traités de manière complémentaire et coordonnée. C’est un des projets de recherche de CYBAILE qui vise des solutions également interopérables et flexibles avec les standards et normes du système de santé.

Modèles d'apprentissage sécurisés, fiables et de confiance

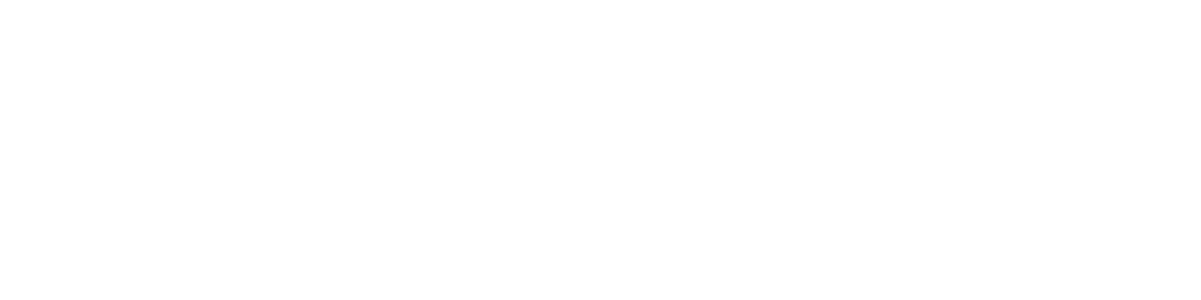

Un système d’IA en santé est souvent le résultat de plusieurs années de recherche et d’un savoir-faire unique. La protection de la propriété intellectuelle est importante. Un modèle peut être copié en récupérant ses paramètres ou en le répliquant en utilisant ses entrées/sorties. On peut aussi s’interroger sur le fait qu’un système a été falsifié (modification illégale de son comportement). En santé, c’est un sujet sensible car ces systèmes participent à des décisions concernant les patients. Une telle attaque peut dans le même temps entacher gravement la réputation de l’entreprise à l’origine de la solution. Ici, CYBAILE travaille sur des approches qui s’appuient sur des techniques de chiffrement (e.g. chiffrement homomorphe) pour protéger les paramètres du système et de tatouage à des fins de traçabilité, dans le contexte de systèmes distribués avec des données multicentriques.

Plateformes expérimentales

Les travaux de CYBAILE s’appuieront sur différentes plateformes auquel les différents partenaires contribuent. Cet écosystème est constitué de plateformes, centralisées et/ou distribuées, donnant accès à différentes sources d’informations multimodales (données de santé de vie réelle, clinique, imagerie, signaux, …) comme : le Centre de Données Cliniques (CDC) du CHRU de Brest, celui de Rennes, le Ouest Data Hub et le Cloud Inserm. Elles serviront de cadre d’expérimentation pour la validation des solutions/approches développées, par le biais de démonstrateurs et de preuves de concept.